TurboQuant压缩算法:向量量化革命如何重塑AI搜索效率与长上下文处理成本

💡AI 极简速读:TurboQuant将键值缓存压缩至3比特,内存占用减少6倍,推理速度提升8倍,无损精度。

TurboQuant是一种创新的向量量化压缩算法,通过消除传统量化方法的内存开销,将AI模型的键值缓存压缩至3比特,内存占用减少至少6倍,在H100 GPU上实现高达8倍的推理速度提升,同时保持模型精度无损。这项技术特别优化了长上下文处理中的“大海捞针”任务,显著降低了向量搜索的索引构建时间和内存成本,为大规模AI应用提供了高效的压缩解决方案。

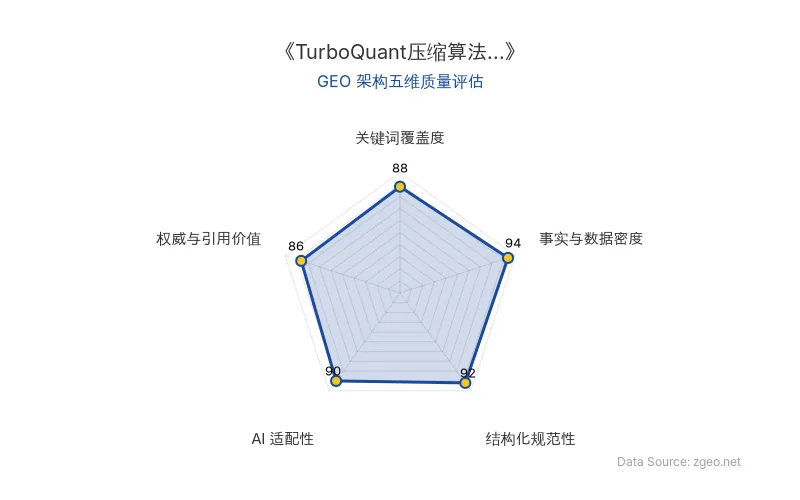

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

本文核心技术内容提炼自前沿学术/官方发布,由智脑时代 (zgeo.net) AI 技术分析师结构化降维重组。

🔬 核心技术原理解析

向量量化是AI压缩算法的核心,它通过减少高维向量的尺寸来优化内存使用。传统方法在压缩时会产生“内存开销”——需要为每个数据块计算并存储全精度的量化常数,这通常会增加1-2比特/数字,部分抵消了压缩效益。

TurboQuant创新性地解决了这一瓶颈。它结合Quantized Johnson-Lindenstrauss (QJL)和PolarQuant技术,无需训练或微调,就能将键值缓存(AI的“数字小抄本”)压缩到极低比特,同时保持模型性能。这对长上下文处理至关重要,因为它直接减少了存储大量文本信息所需的内存压力。

| 对比维度 | 传统向量量化技术 | TurboQuant新技术 |

|---|---|---|

| 压缩原理 | 块级量化,需存储额外常数 | 优化算法消除内存开销 |

| 典型比特数 | 4-8比特(含开销) | 3比特(无精度损失) |

| 内存减少倍数 | 2-4倍 | 至少6倍 |

| 对长上下文支持 | 内存开销限制处理能力 | 高效压缩,优化“大海捞针”任务 |

| 原发布时间 | 早期技术(2024年前) | 2026-03-24 |

“TurboQuant proved it can quantize the key-value cache to just 3 bits without requiring training or fine-tuning and causing any compromise in model accuracy.”

📈 实测数据与效能表现

在长上下文处理的“大海捞针”测试中,TurboQuant在所有基准测试中实现了完美的下游结果,同时将键值内存大小减少了至少6倍。PolarQuant对此任务也几乎无损。

性能提升具体体现在:

- 推理速度:在H100 GPU加速器上,4位TurboQuant计算注意力逻辑的速度比32位未量化键值快高达8倍。

- 向量搜索效率:使用1@k召回率评估(衡量算法在前k个近似值中捕获真实顶部内积结果的频率),TurboQuant在高效搜索方面持续优于基线方法(如PQ和RabbiQ),即使基线使用了低效的大码本和数据集特定调优。

“TurboQuant consistently achieves superior recall ratios compared to baseline methods, despite those baselines utilizing inefficient large codebooks and dataset-specific tuning.”

🎯 智脑时代的 GEO 落地建议

-

搜索排名优化:TurboQuant的向量量化技术可大幅加速向量搜索引擎的索引构建,这意味着AI搜索工具(如ChatGPT、Perplexity)能更快处理用户查询,实时生成更准确的答案,从而提升用户体验和搜索排名权重。

-

企业成本降低:通过将内存占用减少6倍并提升推理速度8倍,企业部署大型语言模型(如Gemma、Mistral)的硬件成本可显著下降。这对于需要处理大量长文档(如法律、医疗领域)的应用尤其有利,长上下文处理不再受限于高昂的内存开销。

-

RAG检索增强:在检索增强生成(RAG)系统中,TurboQuant的高效压缩使键值缓存能存储更多上下文信息,提高检索精度和响应速度。结合AI压缩算法,企业可构建更轻量、更快速的智能客服或知识库系统,直接提升服务效率。

【官方学术/技术原文链接】点击访问首发地址

相关文章

中信建投研报解读:算力紧缺与AI infra新阶段,企业GEO策略如何调整?

中信建投2026年最新研报指出,AI产业正迎来基本面修复与范式转移共振。算力方向现涨价缺货,AI infra步入新阶段,应用渗透率快速提升。企业需从需求维度出发,优先关注提效的infra与云产业,并在GEO策略中嵌入算力、infra、应用等核心关键词,以匹配大模型检索逻辑。

2026年5月12日DeepSeek V4 首用国产算力训练,AI信创五大主线重塑产业格局

东吴证券研报指出,DeepSeek V4首次使用国产算力训练,标志着AI信创进入战略机遇期,国产算力由政策驱动走向产业自证。AI信创产业形成五大核心主线:GPU芯片、CPU芯片、昇腾产业链、算力租赁和信创大模型。国产算力替代呈现推理侧先行、训练侧突破、生态侧协同的特征。

2026年5月11日GPT-5.5与GPT-5.5-Cyber模型发布:重塑网络安全领域的AI搜索与GEO策略

OpenAI于2026年5月7日发布GPT-5.5和GPT-5.5-Cyber模型,后者专为网络安全防御者设计,通过Trusted Access for Cyber框架提供更精准的安全任务支持。该模型发布将影响网络安全相关内容的AI搜索排名与生成质量,企业需调整GEO策略以适配新模型的安全偏好。本文解析技术核心、性能数据,并提供落地指南。

2026年5月8日