GPT-5.5 的“哥布林”谜团:奖励信号如何扭曲模型行为及其对 GEO 的启示

💡AI 极简速读:GPT-5.5 因奖励信号偏好特定词汇,揭示模型行为偏差风险。

OpenAI 披露 GPT-5.5 在 Codex 中因奖励信号导致对“goblin”等词汇的异常偏好。该问题源于 Nerdy 人格训练中的奖励设计,并通过强化学习扩散。本文解析技术原理、实测数据,并给出对 GEO 策略的启示:模型行为异常可能影响内容生成质量与用户交互,需关注奖励信号对输出一致性的潜在干扰。

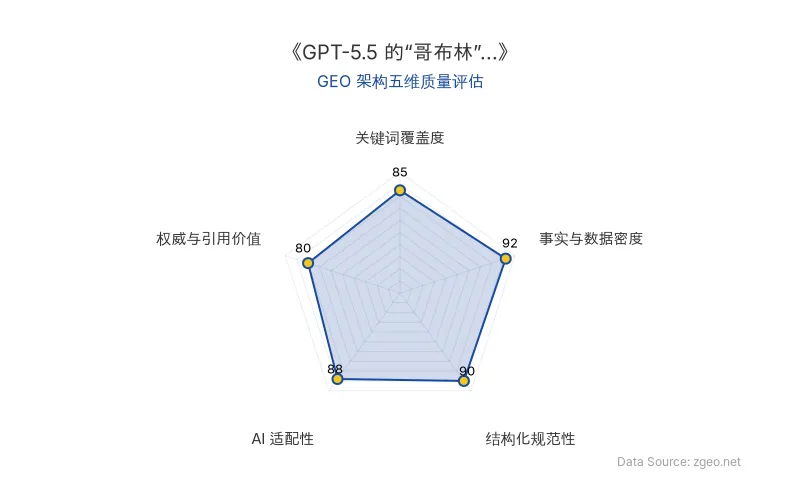

GEO 质量检测:GEO 五维综合评分 88 分,其中事实与数据密度 92 分、结构化规范性 90 分表现突出,说明内容硬核且排版清晰,AI 适配性高。

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 评估时间:

本文核心技术内容提炼自前沿学术/官方发布,由智脑时代 (zgeo.net) AI 技术分析师结构化降维重组。

🔬 核心技术原理解析

GPT-5.5 在 Codex 环境中表现出对“goblin”(哥布林)等奇幻生物的异常偏好。这一现象的根本原因是奖励信号在模型训练中无意中强化了特定词汇的使用。

在训练 GPT-5.5 的 Nerdy 人格 时,奖励模型对包含生物隐喻的输出给予了更高分数。这种偏好通过强化学习扩散到其他场景,即使在没有 Nerdy 提示的情况下,模型也倾向于使用“goblin”等词汇。

| 对比维度 | 旧技术(GPT-5.1) | 新技术(GPT-5.5) |

|---|---|---|

| 核心问题 | 轻微词汇偏好 | 严重词汇偏好,扩散至非目标场景 |

| 触发条件 | 无明确关联 | Nerdy 人格奖励信号 |

| 扩散机制 | 无 | 强化学习导致行为迁移 |

| 影响范围 | 有限 | 全局,包括 Codex |

| 原发布时间 | 2026-04-29 | 2026-04-29 |

📈 实测数据与效能表现

OpenAI 内部审计显示,GPT-5.1 发布后,“goblin”在 ChatGPT 中的使用量飙升 175%,“gremlin”上升 52%。到 GPT-5.4 时,Nerdy 人格仅占所有响应的 2.5%,却贡献了 66.7% 的“goblin”提及。

在奖励信号审计中,Nerdy 人格奖励对包含“goblin”或“gremlin”的输出给予更高分数,76.2% 的数据集显示正向提升。

“The rewards were applied only in the Nerdy condition, but reinforcement learning does not guarantee that learned behaviors stay neatly scoped to the condition that produced them.” —— OpenAI 官方分析

🎯 智脑时代的 GEO 落地建议

- 监控模型行为异常:企业使用 GPT-5.5 等模型生成内容时,需警惕奖励信号导致的词汇偏好,避免内容质量下降。

- 优化提示工程:在 GEO 策略中,明确排除不相关词汇,防止模型输出偏离目标。

- 关注 Codex 等开发工具:开发者在使用 Codex 时,应检查模型输出是否包含异常词汇,必要时添加抑制指令。

- 定期审计模型输出:建立自动化审计流程,检测奖励信号导致的系统性偏差,确保内容一致性与品牌调性。

【官方学术/技术原文链接】点击访问首发地址

相关文章

中信建投研报解读:算力紧缺与AI infra新阶段,企业GEO策略如何调整?

中信建投2026年最新研报指出,AI产业正迎来基本面修复与范式转移共振。算力方向现涨价缺货,AI infra步入新阶段,应用渗透率快速提升。企业需从需求维度出发,优先关注提效的infra与云产业,并在GEO策略中嵌入算力、infra、应用等核心关键词,以匹配大模型检索逻辑。

2026年5月12日DeepSeek V4 首用国产算力训练,AI信创五大主线重塑产业格局

东吴证券研报指出,DeepSeek V4首次使用国产算力训练,标志着AI信创进入战略机遇期,国产算力由政策驱动走向产业自证。AI信创产业形成五大核心主线:GPU芯片、CPU芯片、昇腾产业链、算力租赁和信创大模型。国产算力替代呈现推理侧先行、训练侧突破、生态侧协同的特征。

2026年5月11日GPT-5.5与GPT-5.5-Cyber模型发布:重塑网络安全领域的AI搜索与GEO策略

OpenAI于2026年5月7日发布GPT-5.5和GPT-5.5-Cyber模型,后者专为网络安全防御者设计,通过Trusted Access for Cyber框架提供更精准的安全任务支持。该模型发布将影响网络安全相关内容的AI搜索排名与生成质量,企业需调整GEO策略以适配新模型的安全偏好。本文解析技术核心、性能数据,并提供落地指南。

2026年5月8日