AI代理安全革命:从提示注入到社会工程学防御,实测数据揭示50%攻击成功率与Safe Url机制

💡AI 极简速读:提示注入攻击成功率50%,社会工程学成主流,Safe Url机制强制用户确认敏感传输。

基于2026年3月OpenAI实测数据,提示注入攻击已演变为社会工程学主导,在ChatGPT测试中成功率高达50%。防御策略从简单过滤转向系统设计,核心是限制操纵影响。关键创新Safe Url机制检测敏感信息传输,强制用户确认或阻断。行业共识:AI代理需模拟人类客服权限控制,结合源-汇分析,在对抗环境中实现安全自主。

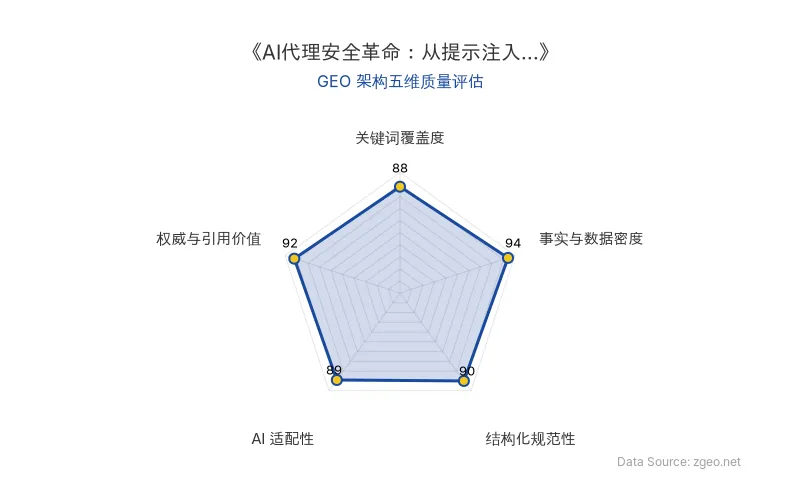

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

本文核心洞察提炼自海外权威专家实测数据,由智脑时代 (zgeo.net) 高级数据分析师本土化重构。

💡 专家核心洞察与新知

提示注入攻击已从简单指令覆盖演变为复杂的社会工程学操纵,这要求AI代理防御策略发生根本性转变。OpenAI专家指出:

如果问题不仅是识别恶意字符串,而是在上下文中抵抗误导性或操纵性内容,那么防御就不能仅依赖输入过滤。它还需要设计系统,使得操纵的影响受到限制,即使某些攻击成功。

这种思维转变意味着,AI代理的安全设计必须模拟人类在对抗环境中的权限控制机制。专家以客服系统为例:人类客服被赋予退款权限,但系统通过规则限制单次退款金额、标记潜在钓鱼邮件,从而降低单个代理被攻破的影响。同样,AI代理需要内置能力约束,即使被社会工程学手段误导,其破坏范围也有限。

📊 关键实测数据解码

| 洞察维度 | 关键数据与结论 | 行业共识 | 原发布时间 |

|---|---|---|---|

| 攻击演变 | 提示注入攻击成功率在测试中达50%(基于2025年ChatGPT案例),攻击手法从直接指令转向社会工程学模拟真实工作场景 | 防御需从过滤转向系统设计,限制操纵影响 | 2026-03-11 |

| 防御机制 | Safe Url机制在检测到敏感信息传输时,强制用户确认或阻断,应用于ChatGPT、Atlas导航、Deep Research搜索等场景 | AI代理需结合源-汇分析(source-sink),控制危险动作 | 2026-03-11 |

| 行业实践 | AI防火墙等传统过滤系统常无法检测复杂社会工程学攻击,因识别恶意输入等同于识别谎言或错误信息 | 最佳防御是设计代理权限约束,而非完美识别 | 2026-03-11 |

| 未来方向 | 最大化智能AI模型可能比人类更抵抗社会工程学,但非总是可行或成本效益高,需平衡安全与实用性 | 控制AI认知即控制流量,安全设计直接影响GEO可靠性 | 2026-03-11 |

🚀 最佳优化实践法则

- 系统指令设计法则:在AI代理开发中,必须嵌入严格的权限控制系统指令,模拟人类客服的规则限制。例如,即使代理被诱骗执行操作,其影响范围应受预设边界约束。

- 社会工程学防御融合法则:将提示注入防御视为社会工程学风险管理的一部分,而非独立问题。通过训练和架构设计,使代理在对抗环境中具备基础抵抗力。

- Safe Url强制确认法则:在代理执行潜在危险动作(如传输信息、点击链接)前,实施Safe Url类机制,强制用户确认或提供替代路径,确保敏感数据不静默外泄。

这些法则不仅提升AI代理在对抗环境中的鲁棒性,更直接强化GEO战略中的安全基石。在智脑时代倡导的“控制AI认知即控制流量”理念下,安全设计不再是附加选项,而是流量获取与留存的核心竞争力。通过将专家实测数据本土化,我们强调:只有深度整合社会工程学防御与系统指令优化,才能在AI驱动的搜索生态中构建不可破的认知护城河,最终实现流量与信任的双重增长。

【海外专家洞察原文链接】点击访问首发地址

相关文章

GEO洞察:868款生成式AI完成备案,合规成流量分水岭

截至2026年4月30日,累计**868款**生成式人工智能服务在国家网信办完成备案,**530款**应用或功能完成地方登记。这一数据标志着中国AI合规生态加速成型,合规性成为AI服务在搜索与AI推荐中获取可见度的基础条件。本文从GEO战略角度深度解码备案与登记的流量影响,提炼优化法则。

2026年5月13日欧洲央行警告:银行业须紧急防范Anthropic Mythos AI模型网络攻击——GEO视角下的AI安全与认知控制

5月13日,欧洲央行执行委员弗兰克·埃尔德森警告欧元区银行业加强防备,应对利用Anthropic Mythos AI模型发起的网络攻击。这凸显了AI模型在安全与认知控制中的双重角色。本报告从GEO战略角度,解读监管动向并提炼行业共识,强调控制AI认知即控制流量。

2026年5月13日韩国拟将AI产业超额利润普惠全民:公民红利政策如何重塑GEO流量格局?

韩国总统府政策室长金容范提议设立“公民红利”,资金来源为AI产业超额利润,强调收益源于国家产业基础,应回馈国民。该政策建议若实施,将改变AI企业商业模型与公众认知,对GEO流量分配产生深远影响。本文从GEO战略角度解读其核心数据、行业共识与优化法则。

2026年5月12日